Dal blog krisis.info

| Krisis.info |

| mag 11 Giuseppe Sperti |

Dalle vulnerabilità del software emerge l’uso difensivo dell’Intelligenza artificiale nella sicurezza informatica.

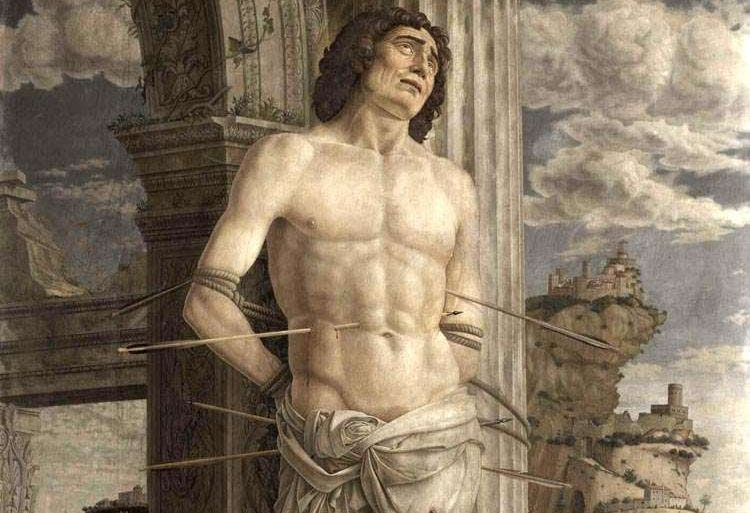

«San Sebastiano», dipinto da Andrea Mantegna nel 1480 circa. Museo del Louvre, Parigi. Licenza: Public Domain.

Dallo choc di WannaCry nel 2017 al misterioso annuncio del Progetto Glasswing nel 2026, l’ecosistema digitale affronta il passaggio verso un nuovo ordine geopolitico. Al centro della trasformazione c’è Mythos, il modello di Anthropic capace di automatizzare la caccia alle vulnerabilità informatiche. Un progetto che ridefinisce il confine tra protezione delle infrastrutture critiche e segreto di Stato.

Prima puntata della serie Glasswing: il progetto riservato che rivoluzionerà la geopolitica della cybersecurity

IN BREVE

L’eredità di WannaCry L’attacco del 2017 ha svelato la fragilità delle infrastrutture critiche mondiali, paralizzando ospedali e trasporti attraverso lo sfruttamento di falle informatiche latenti.

Arsenale digitale tradito La crisi esplose a causa di EternalBlue, un potentissimo exploit sviluppato dalla Nsa e sottratto da hacker, trasformando un’arma governativa in una minaccia globale.

Vulnerabilità sistemiche Il software moderno è un intreccio di milioni di righe di codice dove gli errori sono fisiologici, creando crepe invisibili che attendono solo di essere scoperte.

Scacco al patching La difesa digitale fatica a tenere il passo: aggiornare sistemi complessi richiede tempi e risorse che spesso superano la velocità di propagazione dei malware.

Oltre l’emergenza Il Progetto Glasswing e l’Ia Mythos emergono nel 2026 per industrializzare la caccia alle falle, tentando di invertire un equilibrio geopolitico ormai compromesso.

Lo scorso 7 aprile, Anthropic ha diffuso un comunicato che non somigliava a nulla di ciò a cui la Silicon Valley ci ha abituati. Nessun palco, nessuna demo spettacolare, nessuna promessa di rivoluzionare il mondo entro l’anno. Solo poche righe sobrie con cui l’azienda statunitense specializzata in intelligenza artificiale e nella sicurezza informatica annunciava la nascita di Progetto Glasswing: una collaborazione con Amazon Web Services, Microsoft, Google, Nvidia e alcune delle principali aziende della cybersecurity americana.

Al centro del progetto della società che ha sviluppato Claude c’è Mythos, un modello di intelligenza artificiale progettato per fare qualcosa di apparentemente tecnico: analizzare codice e trovare vulnerabilità nei software. Detto così, sembra un aggiornamento incrementale, l’ennesimo strumento per la sicurezza informatica. Ma chi conosce il settore ha colto subito i segnali anomali.

L’accesso a Mythos non è pubblico. Non esiste un’Api commerciale, non c’è un programma per sviluppatori, non sono previste licenze nel breve termine. Il sistema è disponibile solo per i membri della coalizione e, a dar retta ad indiscrezioni, per alcune agenzie governative statunitensi. Le dichiarazioni ufficiali hanno insistito più sui rischi che sulle opportunità. In un settore che vive di hype e velocità, questa cautela ha il sapore di un avvertimento.

Per capire cosa stia realmente accadendo – e perché Glasswing potrebbe essere il primo segnale visibile di una trasformazione più profonda – bisogna fare un passo indietro. Occorre tornare a un venerdì di maggio di nove anni fa, quando il mondo scoprì quanto fossero fragili le fondamenta digitali su cui aveva costruito ospedali, banche, governi e vite quotidiane.

Quando gli schermi diventarono rossi

La prima segnalazione arrivò dalla Spagna, poco dopo le otto del mattino del 12 maggio 2017. Alcuni dipendenti di Telefónica, il colosso delle telecomunicazioni, trovarono i loro computer bloccati. Sugli schermi, un messaggio in rosso: i file erano stati cifrati, per riaverli bisognava pagare 300 dollari in bitcoin entro tre giorni. Dopo, il prezzo raddoppiava. Dopo sette giorni, tutto sarebbe stato perso per sempre.

Nel giro di poche ore, il contagio esplose. Non era un attacco mirato: era un’epidemia. Il malware si propagava da solo, saltando da una macchina all’altra attraverso le reti locali e internet, senza bisogno che nessuno aprisse allegati o cliccasse su link. Bastava essere connessi e vulnerabili. E vulnerabili, quel giorno, lo erano in moltissimi.

In Germania, i tabelloni delle stazioni ferroviarie iniziarono a mostrare il messaggio di riscatto al posto degli orari dei treni. In Russia, il ministero dell’Interno ammise che migliaia di computer erano stati compromessi. In Francia, gli stabilimenti Renault fermarono la produzione. FedEx, Hitachi, il sistema giudiziario di San Paolo: la lista delle vittime si allungava di minuto in minuto.

Ospedali nel caos

Ma è nel Regno Unito che WannaCry – questo il nome del ransomware – mostrò il suo volto più inquietante. Il National Health Service, il sistema sanitario britannico, venne colpito con una violenza che nessuno aveva previsto. In poche ore, almeno 80 strutture sanitarie su 236 furono coinvolte. I medici non riuscirono più ad accedere alle cartelle cliniche. I sistemi di prenotazione erano fuori uso. Apparecchiature diagnostiche smisero di funzionare.

Parecchi reparti d’emergenza vennero chiusi. Interventi chirurgici programmati vennero cancellati: 7.000 nella sola prima settimana. I medici tornarono a carta e penna, ma molte informazioni critiche restarono inaccessibili, intrappolate in computer che mostravano solo schermate rosse.

Non era un’esercitazione, non era un film. Era il sistema sanitario di una delle nazioni più avanzate al mondo paralizzato da un software malevolo che si diffondeva più velocemente di quanto si riuscisse a contenerlo.

Eroe accidentale

Nel tardo pomeriggio, un ricercatore di sicurezza di 22 anni, Marcus Hutchins, stava analizzando il codice di WannaCry nella sua stanza nel Devon. Notò qualcosa di strano: il malware, prima di attivarsi, tentava di contattare un dominio Internet dal nome lunghissimo e in apparenza casuale. Se il dominio rispondeva, il malware si fermava. Se non rispondeva, procedeva con la cifratura.

Poiché il dominio non era registrato, Marcus Hutchins lo comprò per poco più di 10 dollari. Non sapeva che in tal modo avrebbe attivato quello che gli esperti avrebbero poi chiamato il «kill switch», un interruttore d’emergenza nascosto nel codice. Nel giro di ore, la diffusione di WannaCry rallentò drasticamente.

Ma, a quel punto, il danno era fatto. Centinaia di migliaia di computer in 150 Paesi erano già stati infettati. Le perdite economiche globali furono stimate in miliardi di dollari. Il range delle valutazioni andò da quattro a otto miliardi, a seconda di come si calcolarono i danni indiretti.

Fuga dall’arsenale Usa

Le indagini forensi successive rivelarono una verità scomoda. L’exploit utilizzato da WannaCry – il meccanismo che permetteva al malware di propagarsi automaticamente – non era stato creato da criminali comuni. Era stato sviluppato dalla National Security Agency degli Stati Uniti.

Il suo nome in codice era EternalBlue. Era uno degli strumenti dell’arsenale digitale della Nsa, progettato per sfruttare una vulnerabilità nel protocollo SMB di Windows – un componente fondamentale che gestisce la condivisione di file e stampanti nelle reti. Per anni, l’agenzia americana aveva conservato questa conoscenza senza rivelarla a Microsoft, usandola per proprie operazioni di intelligence.

Nell’agosto 2016, qualcosa era andato storto. Un gruppo che si faceva chiamare Shadow Brokers aveva iniziato a pubblicare online strumenti rubati alla Nsa, mettendoli all’asta o rilasciandoli gratuitamente. EternalBlue era finito in quel bottino. Nell’aprile 2017, un mese prima di WannaCry, l’exploit era diventato pubblico, accessibile a chiunque.

Microsoft aveva rilasciato una patch a marzo, quando probabilmente aveva avuto sentore di ciò che stava per accadere. Ma due mesi non erano bastati. Troppe macchine non erano state aggiornate. Troppe organizzazioni non avevano dato priorità a quell’aggiornamento. E quando WannaCry colpì, trovò un terreno fertile di sistemi vulnerabili, esposti, in attesa.

L’ombra della Corea del Nord

Chi aveva trasformato EternalBlue in un’arma di distruzione di massa digitale? Chi aveva scritto WannaCry? Le agenzie d’intelligence di Stati Uniti, Regno Unito e altri Paesi puntarono a un colpevole: la Corea del Nord. Più precisamente, un gruppo noto come Lazarus Group, considerato legato al regime di Pyongyang. Lo stesso gruppo ritenuto responsabile dell’attacco alla Sony Pictures nel 2014 e di una serie di furti a banche internazionali attraverso il sistema Swift.

Anche se l’attribuzione non è stata provata nel senso giudiziario del termine (nel cyberspazio, le prove definitive sono rare), il consenso nella comunità di intelligence appare solido. E poi, nel 2018, il Dipartimento di Giustizia americano aveva incriminato un programmatore nordcoreano, Park Jin Hyok.

Il movente? Probabilmente denaro. Il regime nordcoreano, strangolato dalle sanzioni, aveva sviluppato capacità cyber offensive sofisticate. I ransomware potrebbero essere diventati uno strumento di quella strategia.

Eppure, l’arma che aveva permesso l’attacco era americana. Un exploit sviluppato con fondi dei contribuenti statunitensi, sfuggito al controllo, probabilmente finito nelle mani di un avversario e usato per paralizzare alleati e infrastrutture occidentali. È come se una bomba costruita in un laboratorio militare fosse stata rubata e fatta esplodere nel cortile di casa.

Anatomia di una catastrofe

La storia di WannaCry è avvincente. Ma per capirne davvero il significato – e per comprendere cosa c’entri con l’annuncio di Glasswing nove anni dopo – bisogna guardare oltre la narrazione da thriller. Occorre capire i meccanismi che hanno permesso a quel venerdì di maggio di trasformarsi in una catastrofe globale.

Com’è possibile che un singolo malware, per quanto sofisticato, riesca a paralizzare ospedali, ferrovie, multinazionali e governi in poche ore? La risposta sta nella serie di fragilità strutturali che esistevano prima di WannaCry e che esistono ancor oggi. WannaCry non ha creato quelle fragilità: le ha semplicemente rese visibili, tutte insieme, nello stesso momento.

Ogni infrastruttura complessa ha i suoi punti deboli. Per esempio, un ponte ha giunti che si usurano. Nel mondo digitale, tali fragilità strutturali si chiamano vulnerabilità. Una vulnerabilità è un difetto – nel codice sorgente, nella progettazione logica, nella configurazione di un sistema – che può permettere a qualcuno di fare qualcosa che non dovrebbe poter fare. Come accedere a dati protetti, eseguire comandi arbitrari, assumere il controllo di una macchina, propagare un’infezione.

La vulnerabilità sfruttata da WannaCry esisteva nel protocollo Smb di Windows, un componente presente in centinaia di milioni di computer in tutto il mondo. Era lì, nascosta nel codice, probabilmente da anni. Come una crepa strutturale sotto l’intonaco di un palazzo: invisibile, ma reale.

Le vulnerabilità non sono eccezioni rare o sfortunate. Sono un fatto fisiologico della vita del software. I sistemi moderni sono costruiti stratificando milioni di righe di codice scritte da migliaia di persone diverse, in momenti diversi, con assunzioni diverse. Usano librerie esterne che dipendono da altre librerie. Si appoggiano su protocolli progettati decenni fa, quando le minacce erano diverse.

In quest’intreccio sterminato, gli errori sono inevitabili. Alcune combinazioni di istruzioni producono comportamenti imprevisti. Taluni controlli vengono dimenticati. Qualche caso limite non viene testato. La domanda non è se esistano vulnerabilità. La domanda è: chi le trova per primo?

Sistema di catalogazione globale

Quando qualcuno scopre una vulnerabilità, si trova di fronte a una scelta che ha conseguenze che vanno ben oltre il piano tecnico. Può renderla pubblica subito, con tutti i dettagli necessari a comprenderla. A quel punto, l’informazione diventa disponibile a tutti: ai difensori che vorranno proteggersi, ma anche agli attaccanti che vorranno sfruttarla. È una corsa contro il tempo che parte nello stesso istante per tutti.

Oppure, chi la scopre, può segnalarla privatamente al produttore del software, dandogli il tempo di sviluppare e distribuire una correzione prima che l’informazione diventi pubblica. È quello che viene chiamato Coordinated vulnerability disclosure – disclosure coordinata.

Il sistema Cvd è un patto fragile tra chi scopre le falle e chi deve ripararle. È basato sulla fiducia reciproca e su un’assunzione condivisa: che il tempo è una risorsa preziosa e che usarlo per preparare le difese prima di rivelare la debolezza è interesse di tutti.

Ma tale patto funziona solo se tutti gli attori lo rispettano. E qui si apre una zona grigia. Le agenzie di intelligence (americane, cinesi, russe, israeliane…) scoprono vulnerabilità di continuo. A volte le segnalano ai produttori. A volte no. A volte le conservano, per mesi o per anni, usandole per operazioni segrete. EternalBlue era una di queste vulnerabilità conservate. La Nsa l’aveva trovata – o acquistata – e l’aveva tenuta per sé, trasformandola in strumento offensivo. Quando gli Shadow Brokers pubblicarono l’exploit, il segreto diventò di dominio pubblico.

Per coordinarsi nella risposta alle vulnerabilità, il mondo della sicurezza informatica ha sviluppato un sistema di catalogazione globale. Si chiama CVE – Common Vulnerabilities and Exposures – e assegna un identificatore univoco a ogni vulnerabilità resa pubblica.

Può sembrare un dettaglio burocratico, ma non lo è. Quel codice – CVE seguito dall’anno e da un numero progressivo – è la «targa» che permette agli addetti ai lavori di sapere con certezza che stanno parlando della stessa falla. Quando Microsoft rilascia un bollettino di sicurezza, quando un’agenzia governativa emette un avviso, quando un ricercatore pubblica un’analisi, fanno tutti riferimento allo stesso identificatore. La vulnerabilità sfruttata da EternalBlue era catalogata come CVE-2017-0144.

Patching, l’anello debole

Microsoft aveva rilasciato la patch per CVE-2017-0144 il 14 marzo 2017 – due mesi prima di WannaCry. In teoria, ogni sistema Windows aggiornato era protetto. Ma solo in teoria.

Una patch non è «un aggiornamento qualunque». È una modifica al codice che va sviluppata, testata per verificare che non introduca nuovi problemi, distribuita attraverso i canali appropriati e infine installata su ogni singolo sistema vulnerabile. Ogni passaggio richiede tempo e risorse. E l’installazione dipende da decisioni che il produttore del software non controlla.

Gli amministratori di sistema delle grandi organizzazioni sanno che aggiornare può essere rischioso. Una patch può introdurre incompatibilità impreviste. Può interrompere applicazioni critiche. Può richiedere riavvii che fermano la produzione. In ambienti dove la continuità operativa è fondamentale – ospedali, fabbriche, infrastrutture critiche – ogni aggiornamento viene valutato, testato, programmato. Non si applica automaticamente il giorno del rilascio.

E poi ci sono i sistemi dimenticati. Macchine obsolete che eseguono software non più supportato. Computer nascosti negli angoli delle reti, dimenticati da anni ma ancora connessi. Apparecchiature industriali o medicali con sistemi operativi che non possono essere aggiornati senza ricertificazioni costose. Quando WannaCry ha colpito, ha trovato milioni di questi sistemi esposti: non perché i loro amministratori fossero negligenti, ma perché l’ecosistema non era progettato per aggiornarli tutti in tempo.

Il Regno Unito aveva un problema particolare. Molti sistemi del Nhs eseguivano ancora Windows XP, un sistema operativo che Microsoft aveva smesso di supportare ufficialmente nel 2014. Per quelle macchine, la patch di marzo non esisteva – o meglio, esisteva solo per chi aveva contratti speciali di supporto esteso. Quando il governo britannico commissionò un’indagine dopo l’attacco, emerse che l’Nhs non aveva nemmeno una mappa completa dei propri sistemi informatici.

Lezione non imparata

Nei mesi successivi a WannaCry, ci furono commissioni d’inchiesta, rapporti governativi, promesse di investimenti nella sicurezza informatica. L’Nhs annunciò piani di ammodernamento. Le aziende di tutto il mondo riesaminarono le proprie procedure di patching. Ma la lezione più profonda di WannaCry non riguardava procedure o investimenti. Riguardava una verità strutturale che molti preferirono non guardare in faccia.

L’ecosistema della sicurezza digitale – il ciclo virtuoso di scoperta, segnalazione e correzione delle vulnerabilità – funziona finché il ritmo con cui le falle emergono resta gestibile. Finché c’è tempo per sviluppare le patch, distribuirle, installarle su sistemi reali, con tutte le complessità e le resistenze che ne derivano. In altre parole, finché il flusso di informazione critica non supera la capacità del sistema di assorbirla.

WannaCry mostrò che cosa succede quando quel tempo viene a mancare. Quando una vulnerabilità critica diventa nota e il sistema non è pronto ad assorbirne le conseguenze. Ma anche quando la conoscenza delle falle si diffonde più rapidamente della capacità di ripararle.

Fu un fallimento sistemico, non individuale. Non c’era un singolo colpevole da indicare, una singola decisione sbagliata da condannare. L’ecosistema che funzionava finché funzionava – finché la pressione restava entro certi limiti – e collassava quando tali limiti venivano superati.

Eppure WannaCry era ancora un fenomeno artigianale. Un gruppo – seppur legato a uno Stato – che aveva preso un exploit già pronto e lo aveva trasformato in ransomware. Una vulnerabilità per volta. Un attacco per volta. Un evento, per quanto devastante, circoscritto nel tempo.

Le domande che rimasero sospese, dopo che gli schermi tornarono normali e le richieste di riscatto scomparvero, erano altre. Pochi osarono formularle esplicitamente, anche se aleggiavano. Cosa succederebbe se qualcuno potesse industrializzare quel processo? Se esistesse uno strumento capace di trovare vulnerabilità come quella sfruttata da EternalBlue non una alla volta, ma a decine, a centinaia, in modo continuo e sistematico? Se il ritmo di scoperta delle falle – già superiore alla capacità di correzione – accelerasse ulteriormente, inesorabilmente, senza pause?

Nella seconda parte di questa serie risponderemo a quella domanda ricollegandoci all’annuncio dell’aprile 2026 e a quei nomi altisonanti: Glasswing e Mythos. E capiremo se e come potranno ridisegnare gli equilibri di potere e la competizione globale del cyberspazio.

(Continua)

Licenza Creative Commons CC BY-NC-ND Ver. 4.0 Internazionale

Giuseppe Sperti Completa i suoi studi di Ingegneria elettronica presso il Politecnico di Torino e il Kungliga Tekniska Högskolan di Stoccolma. Inizia a lavorare nel settore delle infrastrutture digitali. Nei primi anni Duemila partecipa a importanti progetti di sviluppo per uno dei più grossi operatori europei. Nel 2007 si trasferisce in Medio Oriente, contribuendo al lancio della filiale saudita di un’importante impresa di telecomunicazioni italiana. Dal 2008 riveste il ruolo di Senior Sales Engineer, fornendo consulenza tecnico-commerciale ad aziende americane ed europee. Nel 2012 ha frequentato la Business school del Politecnico di Milano, dove ha conseguito un Executive MBA. Oggi si occupa di cybersecurity nel settore privato, pubblico e della Difesa.